MosaicML发布了一个拥有70亿参数的模型 MPT-7B-8

近日,MosaicML发布了一款名为MPT-7B-8K的巨型模型,其拥有超过70亿个参数。据悉,MPT-7B-8K模型是基于深度学习技术开发而成,旨在通过训练大规模数据,提高机器学习的性能和效果。这款模型的发布对于机器学习领域来说具有重要意义,它将为各种应用场景带来更高精度的预测能力和更快的计算速度。同时,MPT-7B-8K模型的巨大参数规模也对计算资源提出了挑战,试图在普通计算平台上运行该模型可能会面临一些困难。然而,随着计算技术的不断进步,相信这一问题将在未来得到解决。MosaicML的发布无疑为机器学习行业注入了新的活力,相信它将在未来的发展中起到重要的推动作用。

据悉,该模型一次可以处理 8000 字文本,相当擅长处理长文重点摘要和问答,还能在 MosaicML 平台上根据特定任务,进一步微调相关配置。

据悉,系列模型采用了 150 万个 Token,并以 256 块 H100 GPU 花 3 天完成模型训练而成。MosaicML 本次发布了 3 个版本模型,包括 MPT-7B-8k、MPT-7B-8k-Instruct 和 MPT-7B-8k-Chat。

故宫博物院:禁止穿拖鞋参观!

热点 博物馆 微信公众号 拖鞋 网友 新闻 资讯 直播 视频 美图 社区 本地 热点 2023-07-23

张柏芝穿紧身露背长裙亮相 卷发造型显气质

娱乐热点 张柏芝 造型 长裙 紧身 气质 新闻 资讯 直播 视频 美图 社区 本地 热点 2023-09-23

北京千万资产家庭数量全国第一:人员平均工资均超20万 半导体等行业最吃香

科技热搜 工资 行业 资产 北京 家庭 新闻 资讯 直播 视频 美图 社区 本地 热点 2023-12-07

全长183.663公里!绥大高速公路正式通车运营:共设9处收费站

科技热搜 绥化 大庆 高速公路 卫星 中国铁建 新闻 资讯 直播 视频 美图 社区 本地 热点 2024-03-06

圣旗H610M-HIH 嘿嘿主板图赏:别出心裁的H610 D5主板

科技热搜 ssd type-c 京东 酷睿 intel 新闻 资讯 直播 视频 美图 社区 本地 热点 2024-03-06

曾被卖出19万美元高价!这台初代iPhone太猛了

曾被卖出19万美元高价!这台初代iPhone太猛了

热门赛事

苹果首次允许欧盟用户从网站安装应用/雷军称对汽车价格战做好准备/微博上线热搜投诉入口

科技热搜 2024-03-13

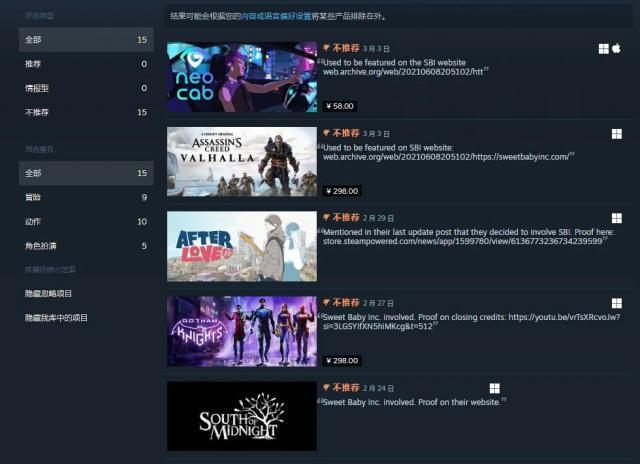

在游戏里搞政治正确的幕后黑手,快被外国网友冲烂了。

科技热搜 2024-03-13

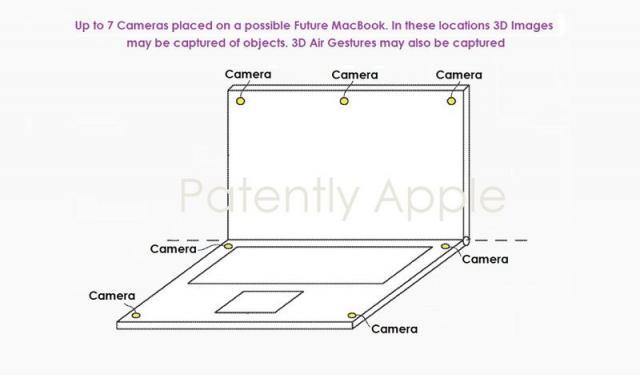

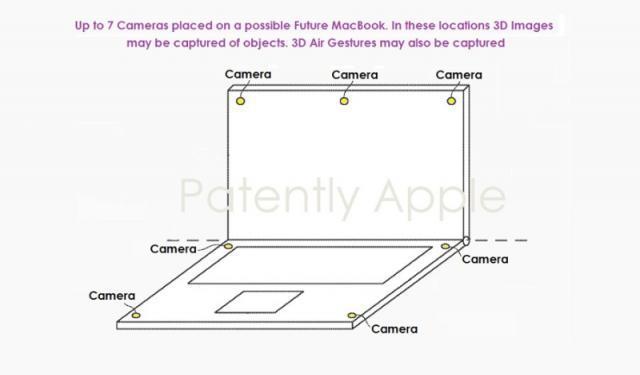

苹果 MacBook 新专利获批:可录制3D 图像/视频、追踪空中手势

科技热搜 2024-03-13

芯片代工营收排行榜公布:台积电独占六成,狂揽近200亿美元

科技热搜 2024-03-13

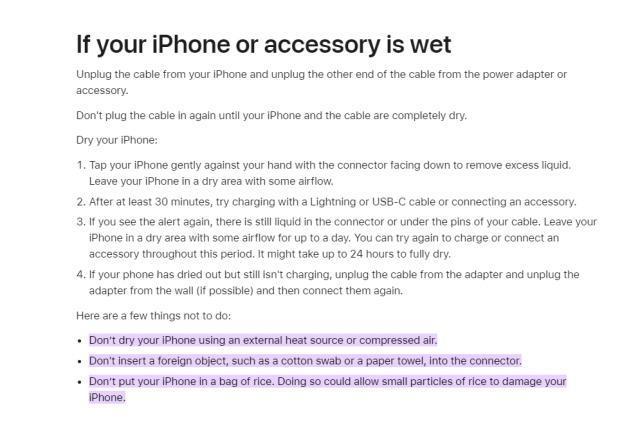

手机进水放米缸?苹果说这招没用。

科技热搜 2024-03-13

TikTok以“美式”反击“美式”

科技热搜 2024-03-13

消息称暴雪国服回归将在一个月内官宣,网易雷火营销/互娱运营

科技热搜 2024-03-13

从“放生”农夫山泉开始,这事算是彻底成互联网闹剧了。

科技热搜 2024-03-13

苹果获得适用于折叠设备和MacBook的摄像头系统专利

科技热搜 2024-03-13

消息称现代汽车将研发5纳米车用半导体,有望由三星、台积电代工

科技热搜 2024-03-13